“张文宏”深夜带货?紧急提醒!

最近,有网友发消息称“张文宏是不是带货了?”视频中,张文宏在卖一种蛋白棒,家里的老人信以为真,已经下单,还转发了很多群。

据媒体报道,这个账号名为“般画234”。在视频中, “张文宏”反复介绍一种产品,口型是他的,声音也是他的,但稍微懂点AI的小伙伴们一眼就能分辨,这是AI合成的视频!

目前,这段视频已在该账号内不可见,但商品橱窗内还保留着蛋白棒售卖的页面, 并显示已售出1266件。

近年来

AI剪辑冒充明星的案例屡见不鲜

也有不少人因此上当

今年11月,江西一位老人来到银行办理银行卡,但手续不全又不肯离开,警方到现场后,老人表示要到银行贷款200万元给自己的男朋友“靳东”拍戏。

民警随即拿起老人的手机进行查看,发现老人所谓的大明星“靳东”是骗子冒充的,其所发布的视频也是由电脑AI合成,但老人对网络知之甚少,对于骗子所说所做深信不疑。

最终,民警通过向老人展示网络上一些冒充“靳东”诈骗的新闻和现场利用AI合成照片等方式,老人才幡然醒悟,表示不会再相信网络上的“靳东”,并放弃了开卡贷款的念头。

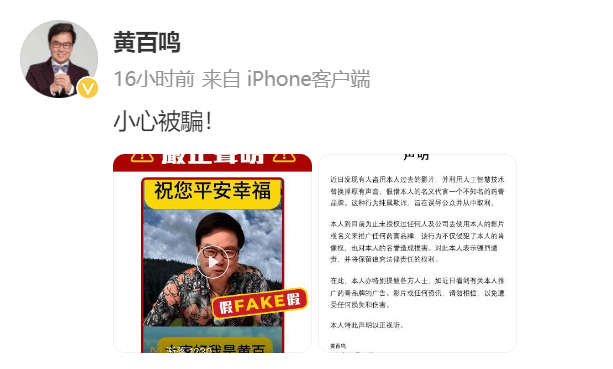

今年10月,老牌港星黄百鸣在社交媒体上发布声明表示,有人盗用他过去的影片,并利用人工智慧技术替换掉原有声音,假借自家名义代言一个不知名的药膏品牌。这种行为纯属欺诈,旨在误导公众并从中取利。

在点对点的沟通过程中, 可以问一些只有对方知道的问题,验证对方的真实性。

还可以让对方通过按鼻子按脸的方式,观察其面部变化,真人的鼻子按下去是会变形,但AI生成的鼻子并不会,同样脸部也是一样的。

值得注意的是,以上鉴别方式都是基于现有算法的局限性。未来随着AI技术的发展,“动起来”“挥手”“比数字”等有可能难不倒新技术,“数字人”同样能顺利完成以上动作,从而更加具备迷惑性。所以,防范AI诈骗,还是要从自己出发,做好信息保护,提高警惕。